Хотя многие браузеры интегрируют функции искусственного интеллекта в свои браузеры, Opera стала первым браузером, интегрировавшим локальные модели искусственного интеллекта. Opera добавляет в свой браузер Opera One экспериментальную поддержку более 150 вариантов локальных моделей большого языка (LLM) примерно из 50 различных семейств моделей.

Поскольку языковые модели будут локальными, пользователям не придется беспокоиться о том, что их данные будут отправлены на сервер LLM. Это частный и безопасный способ использования ИИ.

Чтобы использовать локальные модели LLM, вам потребуется 2–10 ГБ места на вашем компьютере, в зависимости от варианта, который вы будете использовать. Некоторые из поддерживаемых LLM включают Llama от Meta, Phi-2 от Microsoft, Gemma от Google, Vicuna, Mixtral от Mistral AI и т. д. Вы можете использовать эти языковые модели вместо Aria AI из Opera и переключиться обратно на Aria AI, когда захотите. хотеть.

В настоящее время эта функция доступна только в потоке разработчиков Opera One. Вот как вы можете активировать и использовать локальные модели искусственного интеллекта в Opera One Developer.

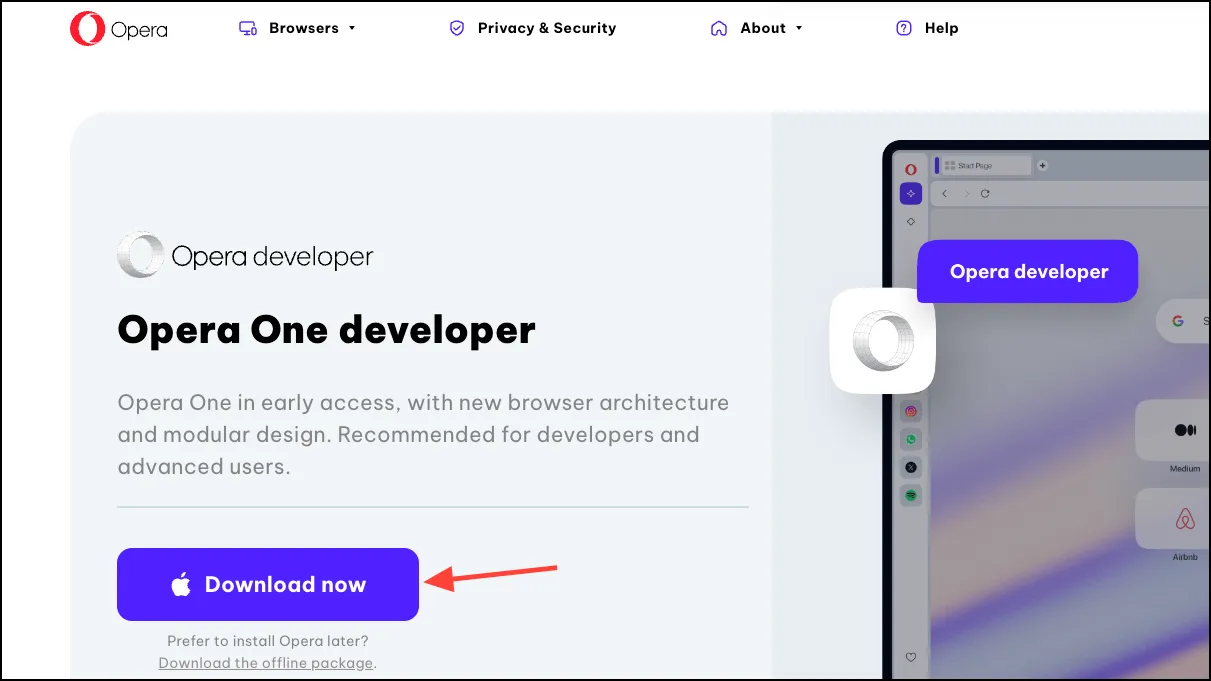

Скачать разработчик Opera One

Если у вас уже есть Opera One Developer, просто пропустите этот раздел и сразу переходите к использованию локальных моделей LLM.

- Перейдите по этой ссылке, чтобы загрузить Opera One Developer. Прокрутите вниз и нажмите «Загрузить сейчас» на плитке «Разработчик Opera One».

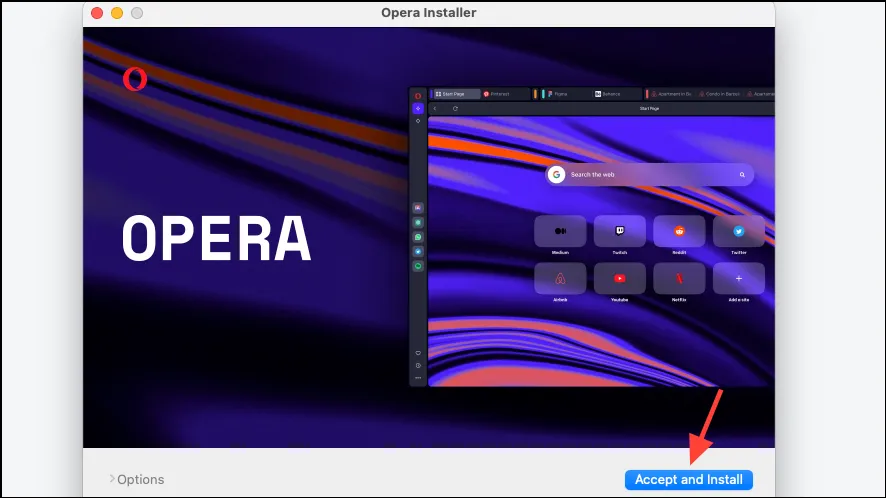

- Откройте файл после загрузки и запустите установщик.

- Нажмите «Принять и установить», а затем следуйте инструкциям на экране, чтобы установить браузер.

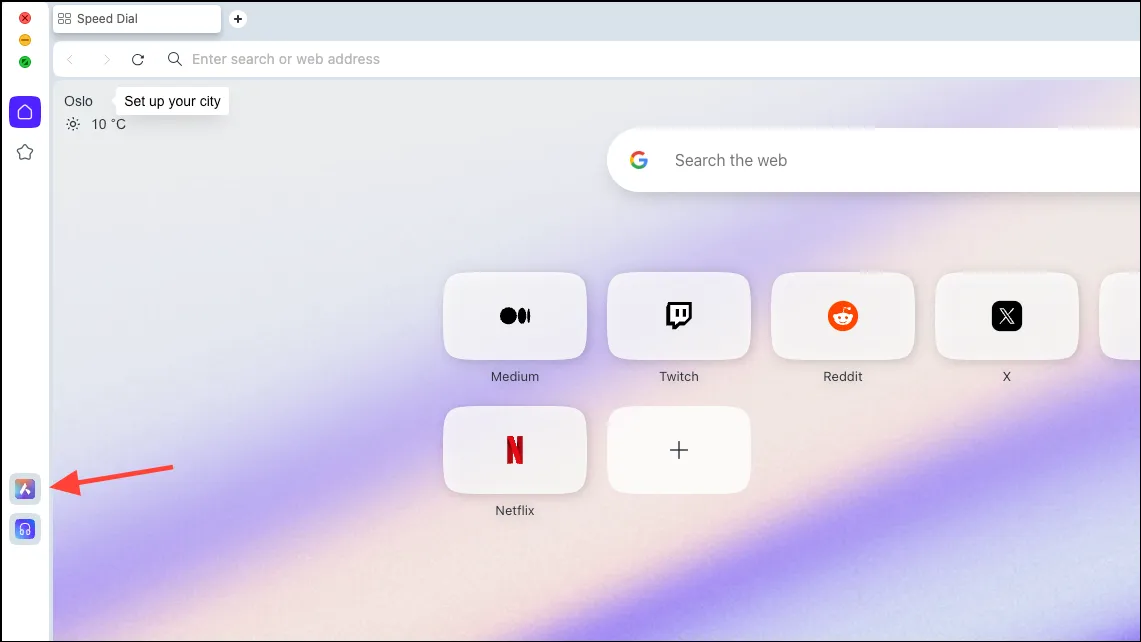

Настройка локальной модели ИИ

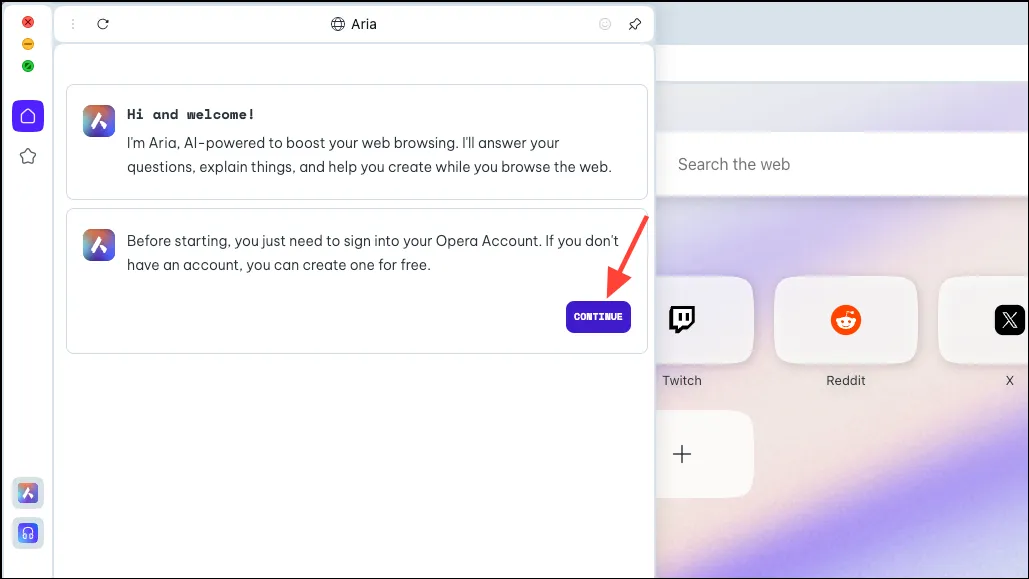

- После загрузки браузера щелкните значок «Aria AI» на левой боковой панели.

- Нажмите «Продолжить», чтобы продолжить.

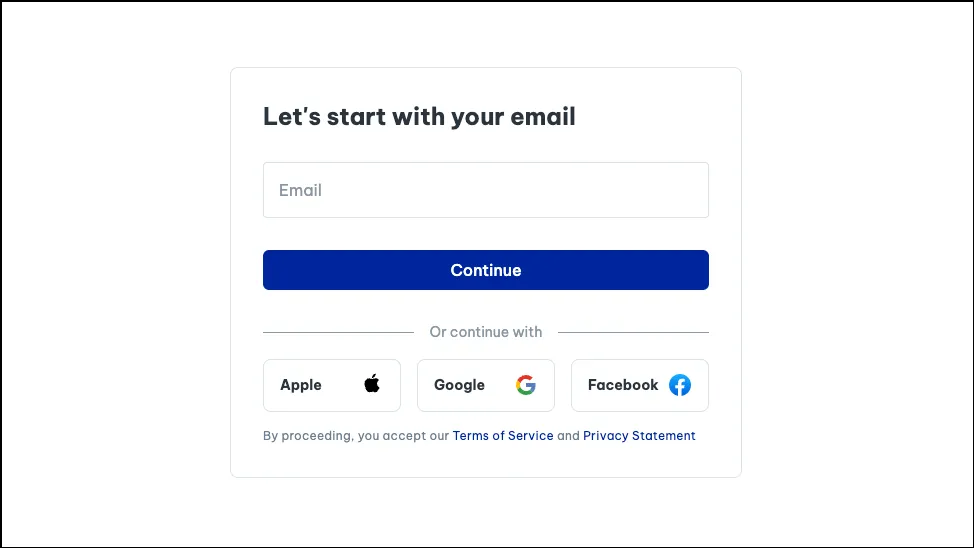

- Если вы используете Aria впервые, вам необходимо зарегистрировать бесплатную учетную запись Opera, чтобы использовать ее. Вы можете использовать свою электронную почту или учетную запись Apple, Facebook или Google для создания учетной записи Opera.

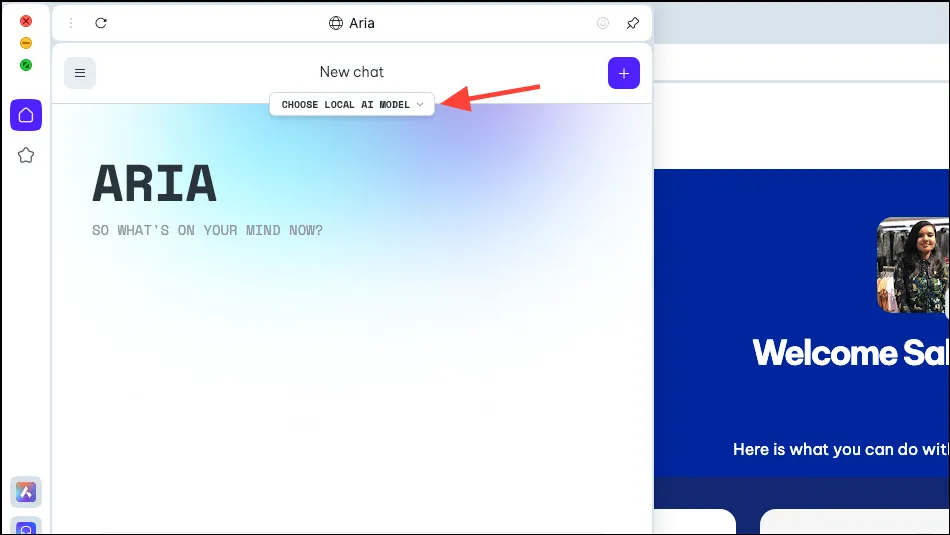

- Как только ваша учетная запись будет создана, вы сможете общаться с Арией.

- Теперь на панели Aria вы увидите опцию «Выбрать локальную модель ИИ». Нажмите здесь.

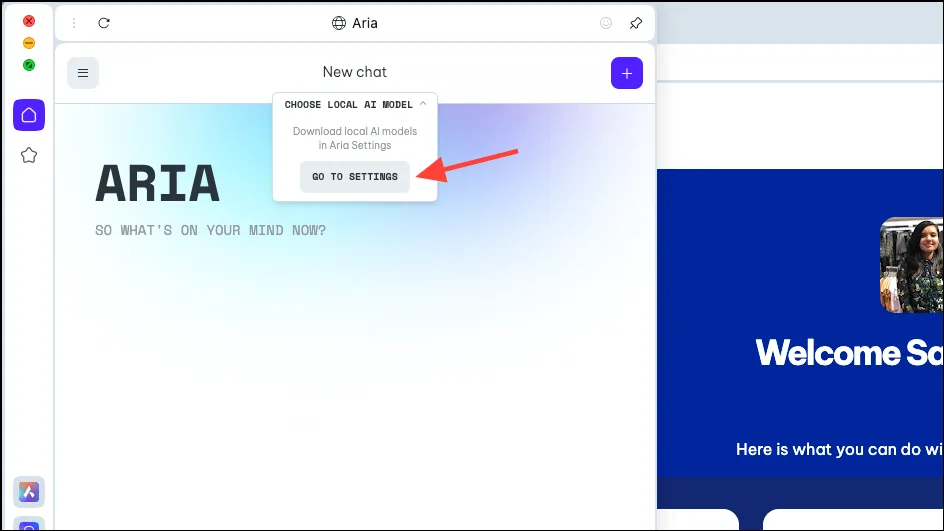

- В раскрывающемся меню выберите «Перейти к настройкам».

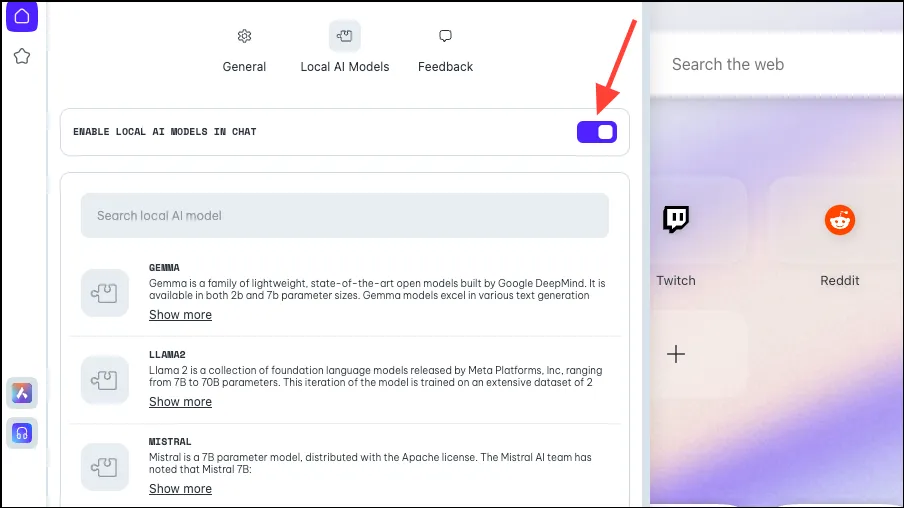

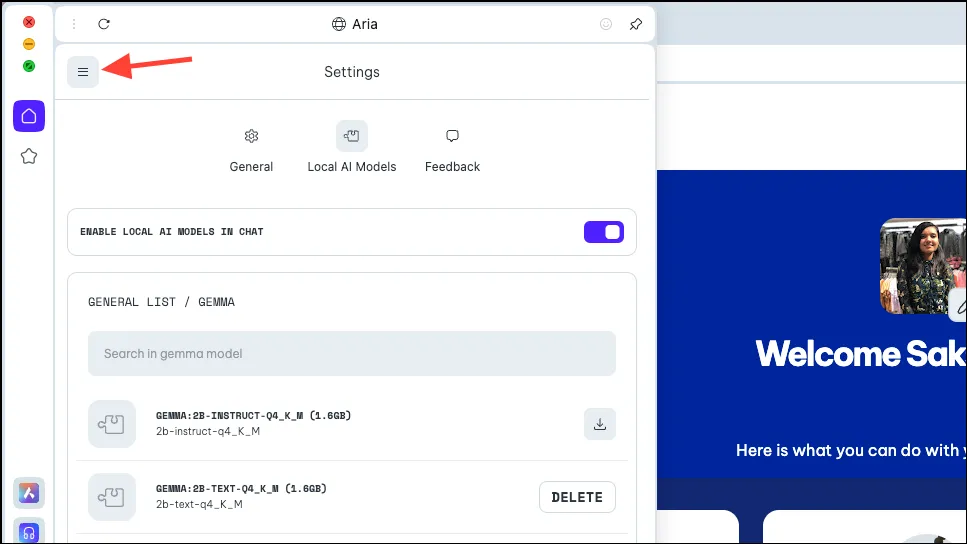

- Убедитесь, что переключатель «Включить локальный искусственный интеллект в чатах» включен.

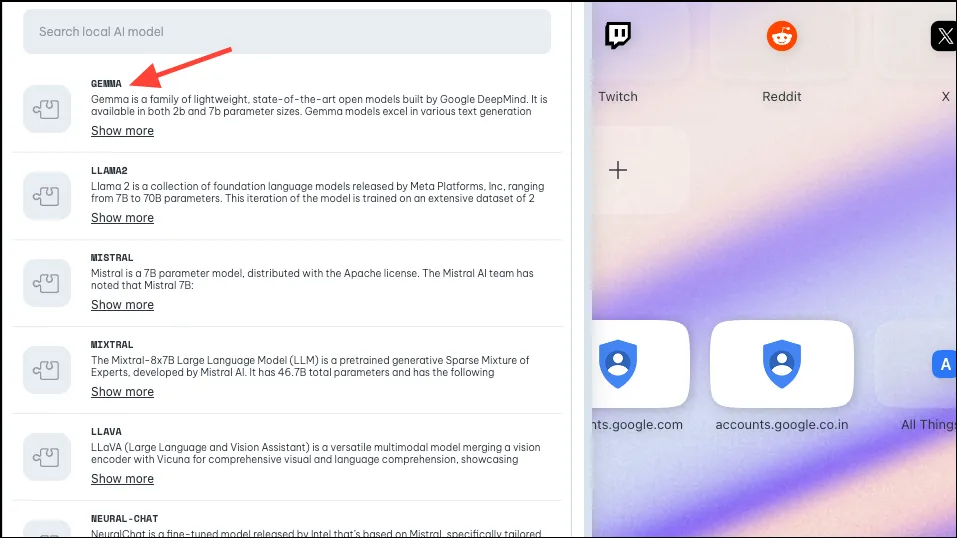

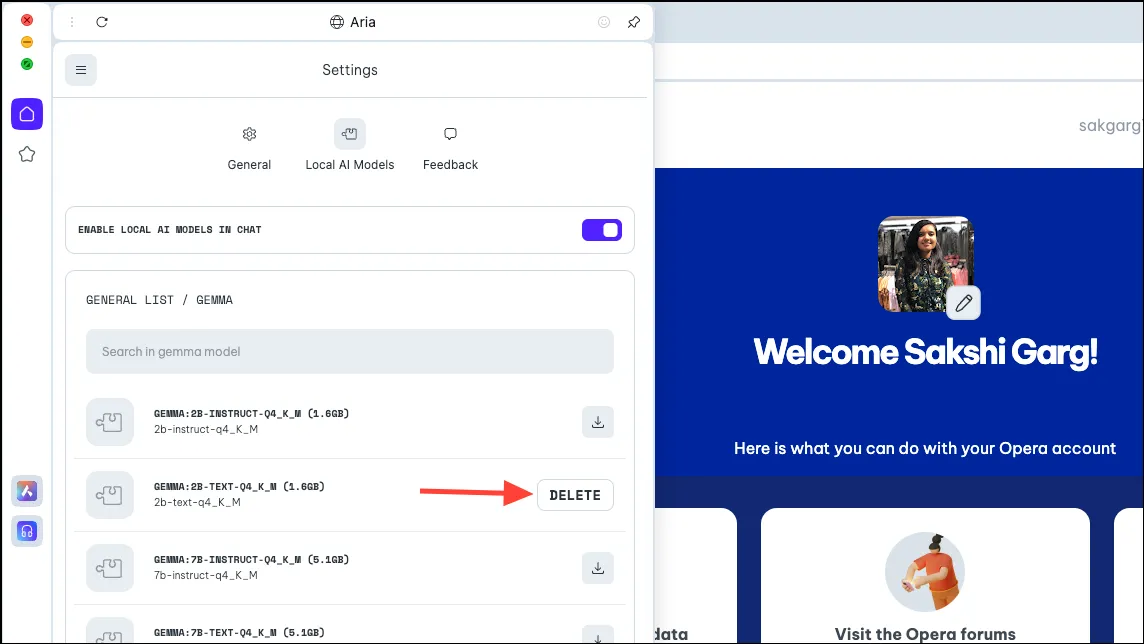

- Затем выберите модель, которую вы хотите загрузить для локального использования, щелкнув ее или выполнив поиск. Как упоминалось выше, Opera реализовала поддержку примерно 50 семейств моделей с различными вариантами, в результате чего общее количество достигло 150.

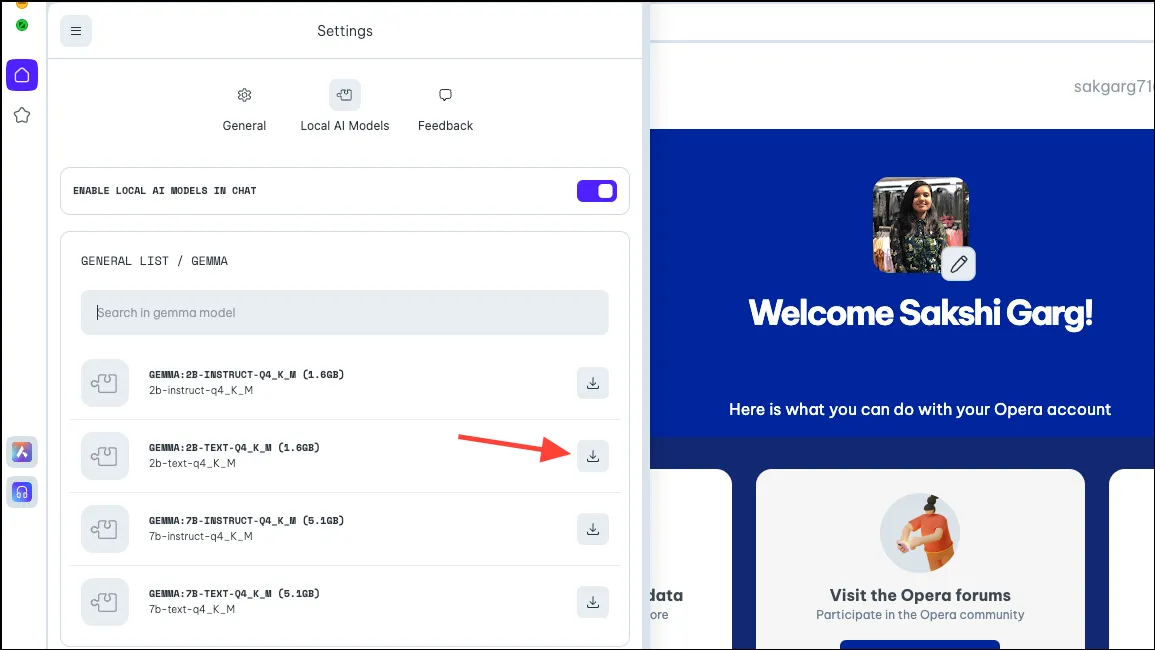

- Итак, для некоторых моделей, если вы щелкнете по некоторым моделям, например, Gemma от Google, вы получите 4 разных варианта. Загрузите модель, которую хотите использовать. Для этого руководства мы загружаем модель 2B Text от Gemma. Нажмите кнопку «Скачать» справа. Перед загрузкой вы можете увидеть, сколько места требуется для модели на вашем компьютере.

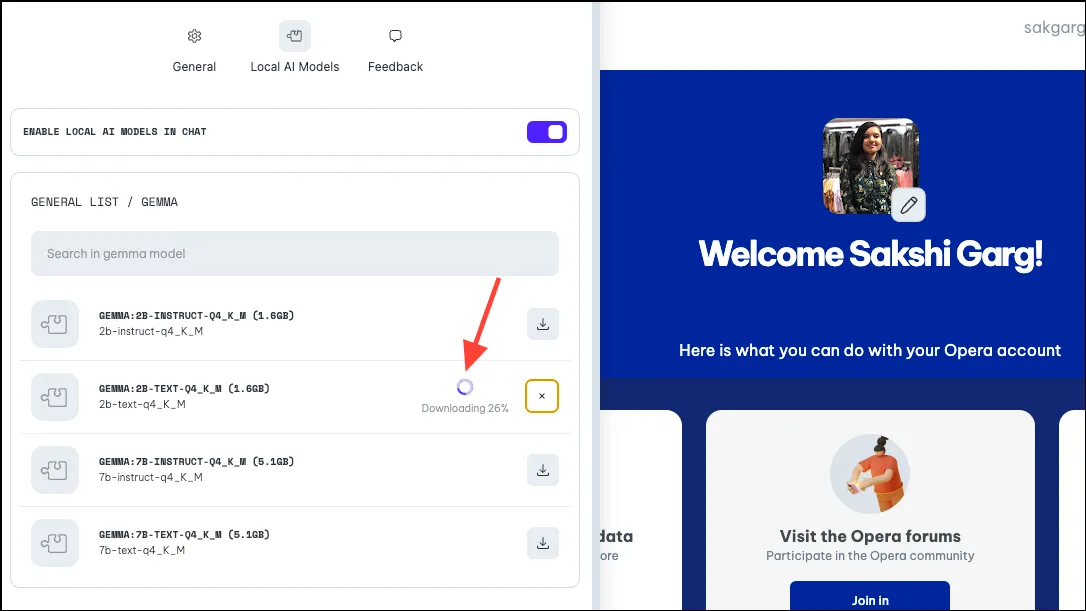

- Загрузка займет некоторое время, в зависимости от размера модели и вашего подключения к Интернету. Рядом с ним вы можете видеть ход загрузки.

Использование локальной модели ИИ

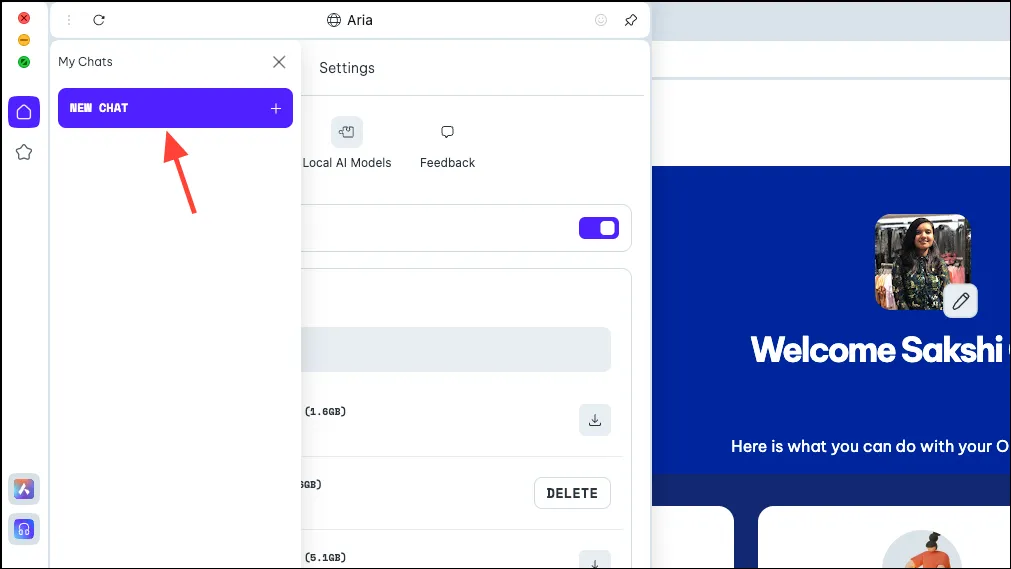

- После загрузки модели щелкните значок «Меню» в левом верхнем углу панели.

- В появившемся меню выберите «Новый чат».

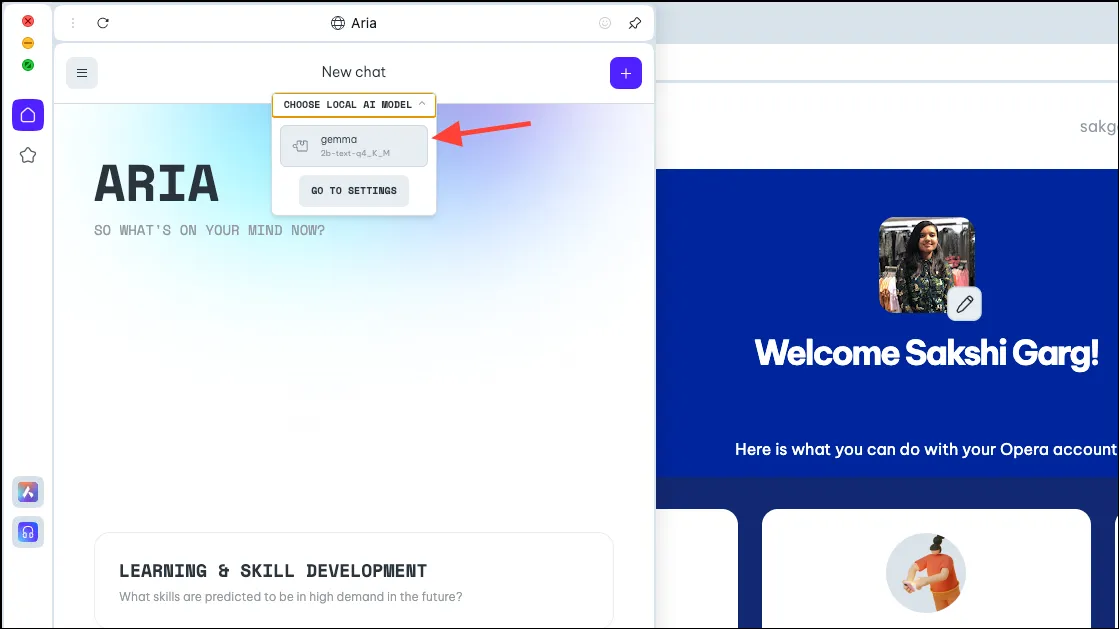

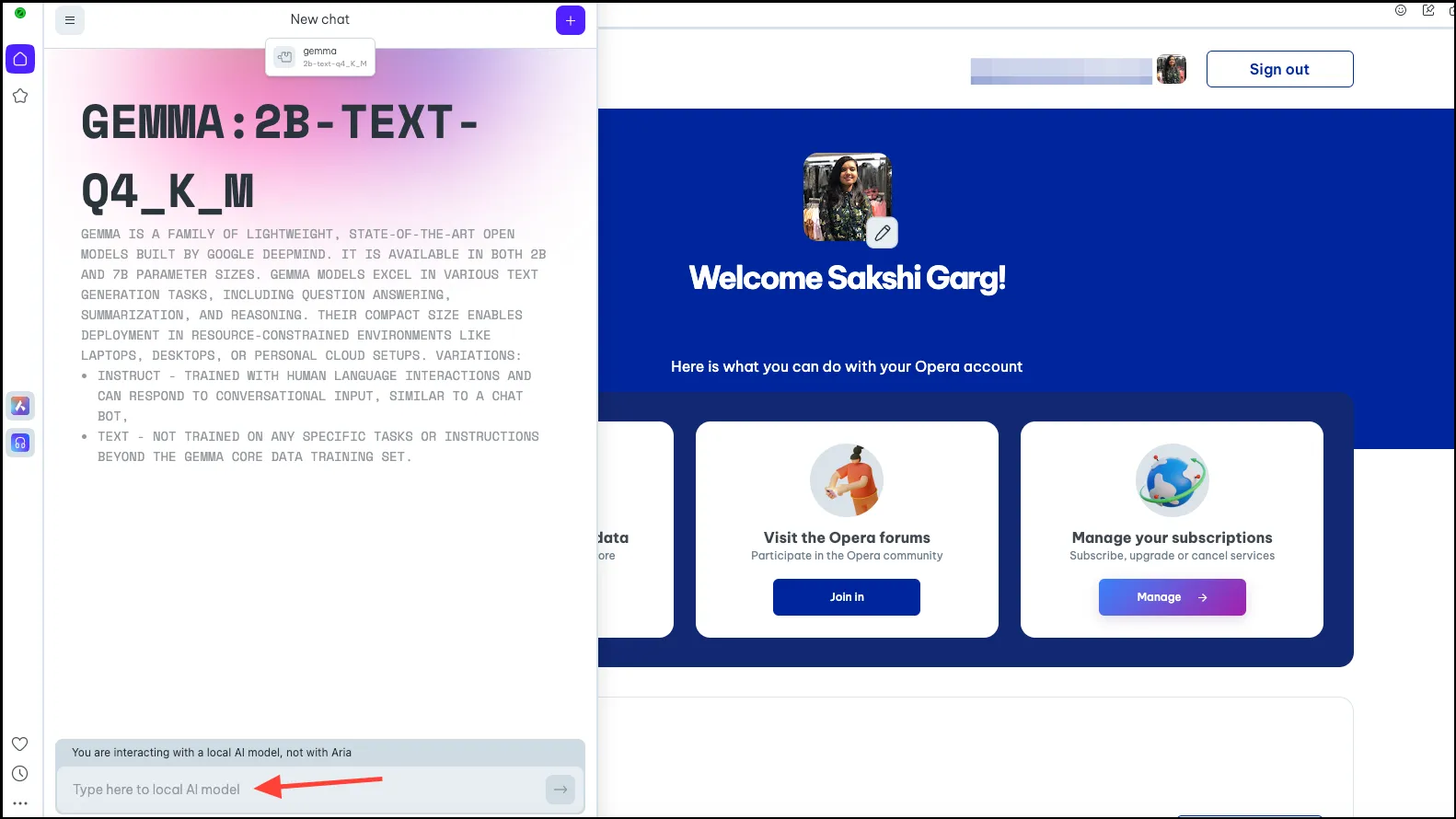

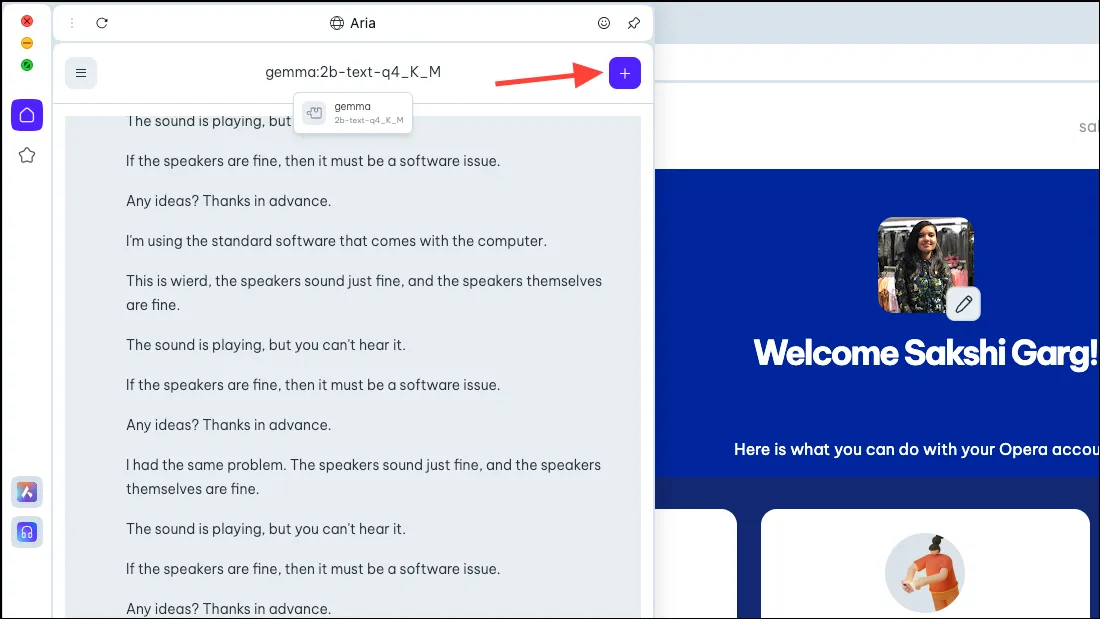

- Снова нажмите кнопку «Выбрать локальную модель ИИ» вверху и выберите в раскрывающемся меню модель, которую вы только что скачали, в нашем случае «Джемму».

- Теперь вы переключитесь на выбранную вами локальную модель ИИ. Введите запрос в строке подсказок и отправьте его ИИ, чтобы начать локальное взаимодействие.

- Ваши чаты с моделью Local AI будут доступны в истории чатов, как и ваши чаты с Aria. Вы также можете переименовать чаты для лучшей организации.

- Точно так же вы можете загрузить и использовать несколько локальных моделей ИИ, но помните, что каждая требует от 2 до 10 ГБ места на вашем компьютере.

- Чтобы удалить модель с вашего ПК, перейдите к тем же настройкам, откуда мы скачали модель ранее, то есть

Aria>>> . Затем нажмите кнопку «Удалить».SettingsLocal AI Models[Downloaded Model]

Вернитесь к Арии

- Чтобы вернуться в Арию, просто начните новый чат с ИИ. Нажмите на значок «+» в правом верхнем углу.

- Новый чат начнется с самой Арией.

Очень интересно иметь возможность использовать локальные модели искусственного интеллекта в браузере Opera One, и не только с точки зрения безопасности и конфиденциальности. Хотя на ранних стадиях все очень просто, потенциальные будущие дела весьма интересны. Браузер с локальным искусственным интеллектом может означать, что он может использовать ваши исторические данные со всеми вашими данными; как это было бы интересно! И команда Opera изучает эту возможность.

Но даже без будущих возможностей локальные ИИ — отличный шаг для пользователей, которые беспокоятся о том, что их данные и чаты с ИИ хранятся на его серверах. Вы можете изучить несколько замечательных программ LLM, например Llama для кодирования, Phi-2 для выдающихся способностей к рассуждению и Mixtral для таких задач, как генерация текста, ответы на вопросы и т. д.

Добавить комментарий